DeepSeek V4 实测:1.6万亿参数跑在国产芯片上,好用吗?

4 月 24 日 DeepSeek V4 发布。过去一周 AI 圈发了七八个新模型,光最近 24 小时就来了四个——MiMo、HY3、GPT-5.5、DeepSeek V4,排着队上。

V4 有两个版本:V4-Pro 和 V4-Flash。总参数 1.6 万亿(V3.2 是 6710 亿,翻了两倍半),上下文 100 万 Token,训练和推理全程跑在华为昇腾芯片上。

直接说结论:跑分在第一梯队,写作能力不错,但 Agent 编程跟 Claude Code 的适配有些问题,而且没有多模态。

跑分:第一梯队,没有碾压

先看知识推理类。V4 在 SimpleQA 这类知识问答上分数很高,接近 Gemini 3.1 Pro。其他推理任务上的表现中规中矩,第一梯队水平,但谈不上大幅领先。

代码方面跟 Gemini 走的是一个路子:竞赛题、算法题比较强,但在真实工程代码能力上,从分数看跟其他头部模型差距不大。LMArena 最新排名里 V4 排第三,第一还是 GLM-5.1。

Agent 能力是这次跑分里最亮眼的部分。DeepSeek 内部已经把 V4-Pro 当主力 Agentic Coding 模型用了,官方说法是体验优于 Claude Sonnet 4.5,接近 Opus 4.6 非思考模式。

整体评价:模型够强,稳稳的第一梯队,但如果你预期的是"碾压所有人",那会失望。

价格:贵了,但有原因

V4-Pro:输入 12 元、输出 24 元 / 百万 Token。 V4-Flash:输入 1 元、输出 2 元 / 百万 Token。

换算成美元的话,V4-Pro 输入 1.74 美元、输出 3.48 美元。作为对比,Claude Opus 4.7 是 5/25 美元,GPT-5.5 是 5/30 美元。国产模型大概比海外便宜 60% 左右。

对一直追求"价格屠夫"人设的 DeepSeek 来说,这个定价不算便宜了。但 DeepSeek 在定价页底部写了一行小字:目前受限于高端算力,Pro 的吞吐有限,预计下半年昇腾 950 超节点批量上市后价格会大幅下调。

也就是说现在的价格不是最终状态,等芯片产能跟上还会降。

为国产芯片设计的三个技术细节

V4 最值得关注的不是跑分,而是它从架构层面就在为国产芯片做准备。技术报告里有三个关键信号:

MXFP4 低精度格式

V4 在后训练和推理里引入了 MXFP4。这是一个开放的低精度浮点格式,不像 NVIDIA 的 FP8 那样绑定特定硬件生态。用 MXFP4 意味着 V4 可以适配华为昇腾、寒武纪、壁仞等国产芯片,降低了对 NVIDIA 的依赖。训练阶段还是用的英伟达体系,但后训练和推理已经可以跑在国产卡上了。

TileLang DSL

V4 的底层算子不再完全用 CUDA 写,改用了一个叫 TileLang 的领域特定语言(DSL)。思路是用更高层的语言描述计算逻辑,然后编译到不同硬件上。这样以后迁移到新硬件时不用把所有算子从头重写。

MegaMoE 融合内核

V4 专门做了一个 MegaMoE 内核,目标是减少 MoE 架构里专家并行带来的通信等待。这个内核已经在华为昇腾上跑通了。

这三件事放一起看,方向很清楚:V4 就是为了跑在国产芯片上设计的。不是情怀,是现实需求——算力被限制出口,模型参数越来越大,Agent 推理消耗的 Token 越来越多,不解决国产算力适配问题,后面只会越来越难。

MoE 架构:1.6 万亿参数为什么推理成本可控

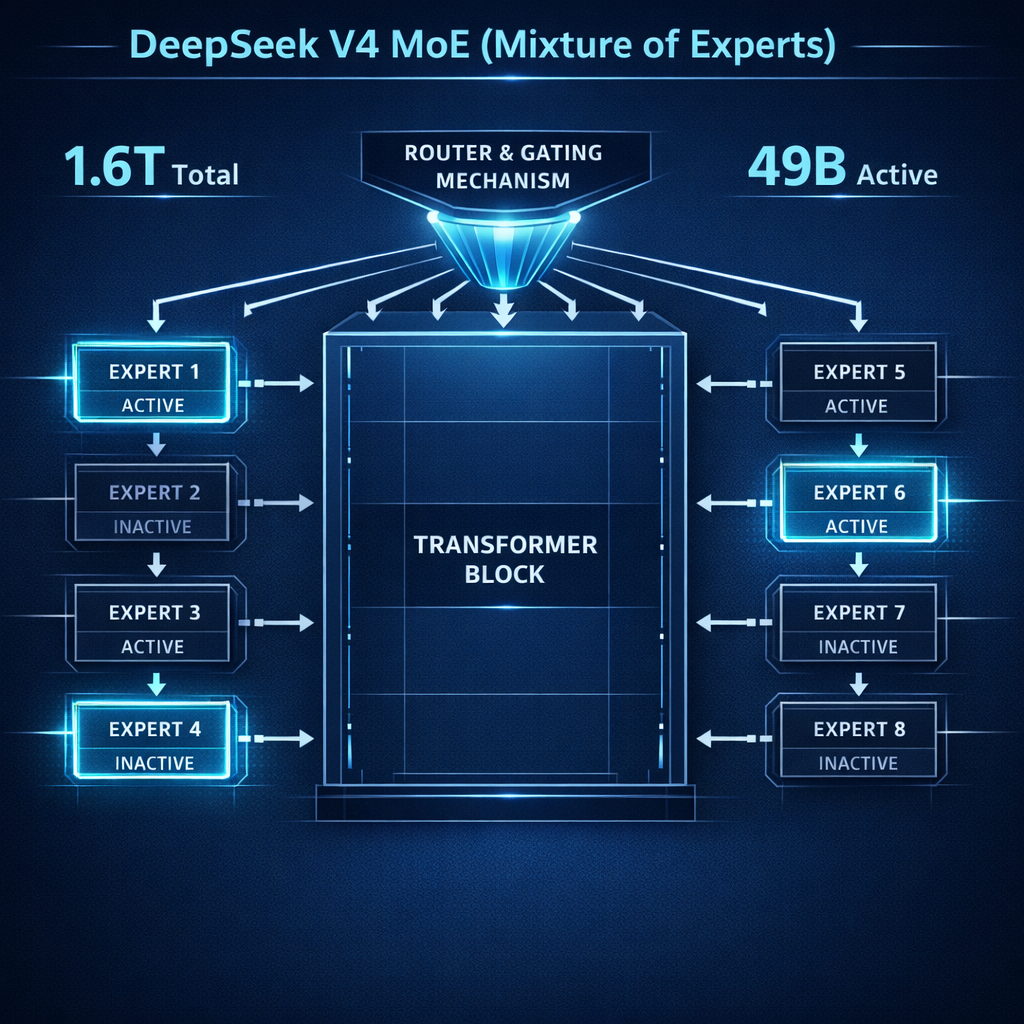

V4-Pro 总参数 1.6 万亿,但每次推理只激活 490 亿。靠的是 MoE(Mixture of Experts)架构。

Transformer 每一层有一个 FFN 模块。MoE 把这个 FFN 拆成很多小的"专家"模块,加一个路由器。路由器根据每个 token 的内容选出最匹配的 2 个专家来处理,其他专家不参与计算。

DeepSeek 的 MoE 有两个特色:一是专家粒度更细——传统做法是 16 个大专家选 2 个,DeepSeek 切成 128 个小专家选 8 个,知识分工更精确。二是加了"共享专家",有 2 个专家每次都参与计算,负责处理通用知识(比如语法),路由专家只处理领域知识。

百万上下文靠的是 MLA(Multi-Head Latent Attention)。传统注意力机制的 KV 缓存在 100 万 Token 时会占用大量显存,MLA 把 Key 和 Value 压缩到低维空间存储,需要时再解压。V4-Pro 和 V4-Flash 都支持百万上下文,说明这个能力是架构层面的优化,跟参数量无关。

实测 Agent 编程:有亮点也有问题

把 V4-Pro 接到 Claude Code 后实测,发现 skill 调用有些问题。

一个具体例子:本地配了一个管理服务器的 skill,用过的 GLM-5.1、MiniMax M2.7、Kimi K2.6、MiMo-V2.5-Pro,只要提到"服务器"相关的词,都能正确调用对应的 skill。但 V4 不行,需要把 prompt 写得非常明确才能触发。

另一个例子:给 V4 一个开发任务(用女神异闻录 5 的风格做招聘网站并部署到服务器),V4 花了 24 分钟完成。UI 做得还行,但有个大问题——没有跟用户确认域名就直接部署了。CLAUDE.md 里明确写了新项目部署必须先确认域名,但 V4 没有遵守这个约束。

写作能力倒是个惊喜。在一众只会写八股文的模型里,V4 的文字算有可读性的。让它写了一篇关于 Token 涨价的文章,自己跑了搜索、过了几层检测,8 分钟交出来的稿子质量还行。中段续写测试里,V4 的效果达不到 Opus 4.6 那种自然流畅的水平,但比 Opus 4.7 好一些。如果用修改幅度来量化的话——Opus 4.6 直出只需要改 30%,Opus 4.7 要改 60%,V4 大概在 45%。

没有多模态

V4 是纯文本模型,不支持图片、音频、视频。

现在多模态几乎是标配了。Opus 4.7 大幅强化了多模态,K2.6 和 MiMo-V2.5-Pro 都标配多模态,GPT-5.5 更不用说。没有多模态意味着没有视觉能力,Computer Use 之类的 Agent 功能也做不了。

之前一直有消息说 V4 会带多模态。DeepSeek 内部大概率做了相关工作,但最终没放出来。推测是适配国产芯片的优先级更高,精力有限。多模态可能要等 V4.5 或 V5 了。

混合模型:为什么没有 R2

很多人问 R2 去哪了。简单说:推理模型和非推理模型已经合并了。

去年 R1 是专门的推理模型,V3 是通用模型,分开的。现在 Claude 和 GPT 都改成了混合架构,用"思考强度"控制模型是否进行深度推理。V3.1 开始 DeepSeek 也改成了混合模型,V4 同样如此。

所以 R2 存在的意义不大了。就像 OpenAI 的 o3 成了最后一代独立推理模型,被并进了 GPT-5。

选什么模型

综合目前测试结果,给几个建议:

如果用海外模型,愿意花订阅费:

- 内容创作(文章、策划案、脚本):Claude Code + Opus 4.6

- 其他所有场景(开发、数据分析、文档处理):Codex + GPT-5.5

如果用国产模型:

- 内容创作:DeepSeek 官网直接用就行,没必要走 Claude Code

- 其他所有场景:Claude Code + GLM-5.1 或 MiMo-V2.5-Pro

V4 的定位比较特殊。它在做的事情——全链路适配国产芯片、MXFP4 低精度格式、TileLang 跨平台编译——对行业意义很大,但对普通用户来说,目前能感知到的体验提升有限。等芯片产能上来、价格降下来、多模态补上之后,V4 的优势才会真正体现出来。

两个版本的参数

| V4-Pro | V4-Flash | |

|---|---|---|

| 总参数 | 1.6T | 284B |

| 激活参数 | 49B | 13B |

| 上下文 | 1M Token | 1M Token |

| 最大输出 | 384K Token | 384K Token |

| 输入价格 | ¥12 / 百万 Token | ¥1 / 百万 Token |

| 输出价格 | ¥24 / 百万 Token | ¥2 / 百万 Token |

V4-Flash 激活参数只有 13B,响应速度快,适合批量调用和对延迟敏感的场景。两个版本都支持百万上下文。

参考资料:DeepSeek V4 技术报告、LMArena 排行榜 (2026.4.25)、华为昇腾 950PR 核验白皮书